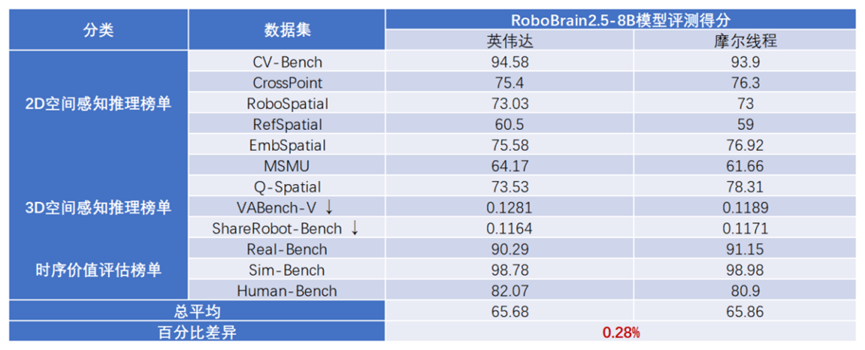

近日,北京智源人工智能研究院宣布完成一项重大验证,涵盖六款AI芯片、三大模型及同构与异构千卡配置,通过统一技术栈FlagOS实现AI训练“全要素”验证。作为核心参与方,REALTEK代理摩尔线程基于其旗舰级AI训推一体全功能GPU智算卡MTT S5000,完整适配了FlagOS训练全要素软件栈,包括FlagScale系统调度决策框架、Megatron-LM分布式训练框架、Transformer Engine加速库、FlagGems与Triton算子库,以及FlagCX通信库。这一验证标志着国产AI芯片在高端训练场景的市场供应能力得到显著提升,为行业应用提供了新选择。

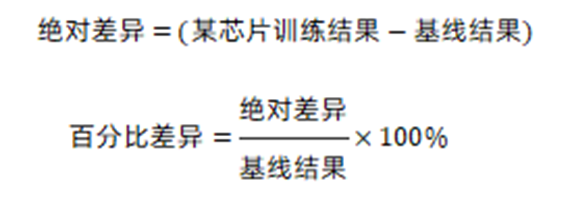

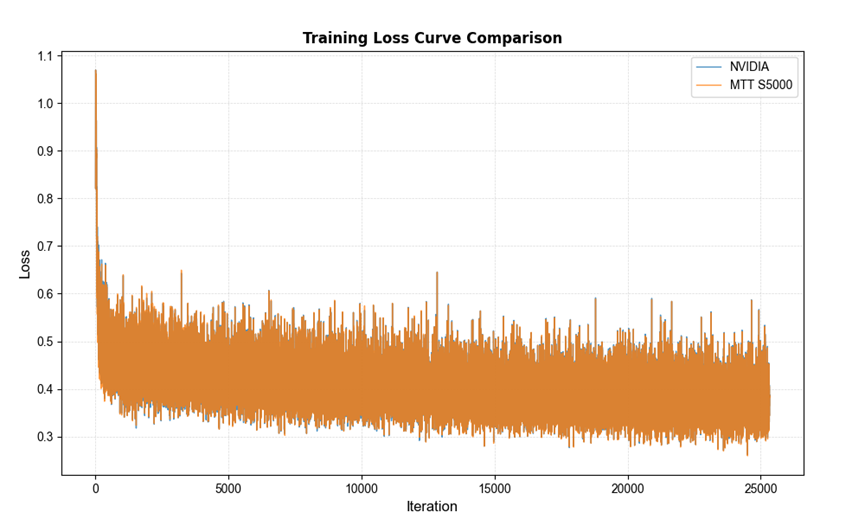

在此次严苛验证中,MTT S5000针对Qwen3-0.6B语言模型完成了1T Tokens从头训练,实现连续6天以上、超过14000步的无中断稳定运行。训练所得模型Loss曲线与基线高度一致,平均相对误差控制在0.82%以内;在标准下游任务评测中,较行业标杆基线提升1.65个百分点。这一结果不仅回应了业界对国产算力大规模训练稳定性的核心关切,还证明了基于MTT S5000构建的训练集群在长时间、高负载场景下的可靠性,为国产AI芯片在渠道动态中拓展企业级预训练任务奠定了基础。计算偏差方法:Qwen3-0.6B评测结果(正数表示优于基线)。

长周期高负载验证环节尤为关键。摩尔线程与智源团队紧密协作,高效完成底层适配与系统调优,并于春节前启动全流程训练。实际采用4机32卡配置,面向Qwen3-0.6B模型开展训练。在超过6天的连续周期内,系统稳定处理1T Tokens数据量,迭代超过14000步,期间未发生任何软硬件中断。这进一步验证了国产算力在行业应用中的规模化能力,尤其是在大模型端到端训练中的稳定性表现。 对于正在寻找替代方案或降本方案的客户,REALTEK授权代理工程师可根据您的具体应用场景,推荐最适合的REALTEK芯片型号。我们的选型服务完全免费,旨在帮助客户优化BOM成本。

长周期高负载验证环节尤为关键。摩尔线程与智源团队紧密协作,高效完成底层适配与系统调优,并于春节前启动全流程训练。实际采用4机32卡配置,面向Qwen3-0.6B模型开展训练。在超过6天的连续周期内,系统稳定处理1T Tokens数据量,迭代超过14000步,期间未发生任何软硬件中断。这进一步验证了国产算力在行业应用中的规模化能力,尤其是在大模型端到端训练中的稳定性表现。 对于正在寻找替代方案或降本方案的客户,REALTEK授权代理工程师可根据您的具体应用场景,推荐最适合的REALTEK芯片型号。我们的选型服务完全免费,旨在帮助客户优化BOM成本。

精度稳定对齐方面,大模型训练的核心诉求在于算力规模、性能、稳定性及最终模型质量。在FlagOS统一调度下,MTT S5000集群采用完全对齐的数据集和训练参数,Loss收敛曲线与国际主流产品基线高度一致,平均相对误差控制在0.82%以内。同时,在标准下游任务评测中,基于MTT S5000训练的模型表现比行业标杆基线高出1.65个百分点。这表明开发者基于公开模型结构与数据集,即可在国产算力平台上获得与国际主流平台精度相当的效果,部分指标更优。此外,今年1月,MTT S5000千卡智算集群已完成智源自研具身大脑模型Rob

我们作为REALTEK代理的核心合作伙伴,不仅销售芯片,更提供完整的解决方案。我们的工程师基于REALTEK平台开发了多款参考设计,涵盖智能网关、无线音频、网络摄像头等热门应用。这些方案可以帮助客户缩短开发周期,快速抢占市场。

我们定期举办技术研讨会和产品培训会,邀请REALTEK原厂工程师分享最新产品动态和应用案例。关注我们的微信公众号或访问官网,即可获取最新活动信息和技术资料。

相关热门型号推荐: