亚马逊云科技(AWS)今日宣布与Cerebras Systems达成多年战略合作,计划将后者的WSE-3人工智能芯片引入云服务。此举旨在加速AI推理工作负载,通过联合研发的解耦架构,模型生成输出速度预计提升5倍。合作将覆盖AWS数据中心部署,标志着云平台在AI芯片领域的重要市场供应突破。

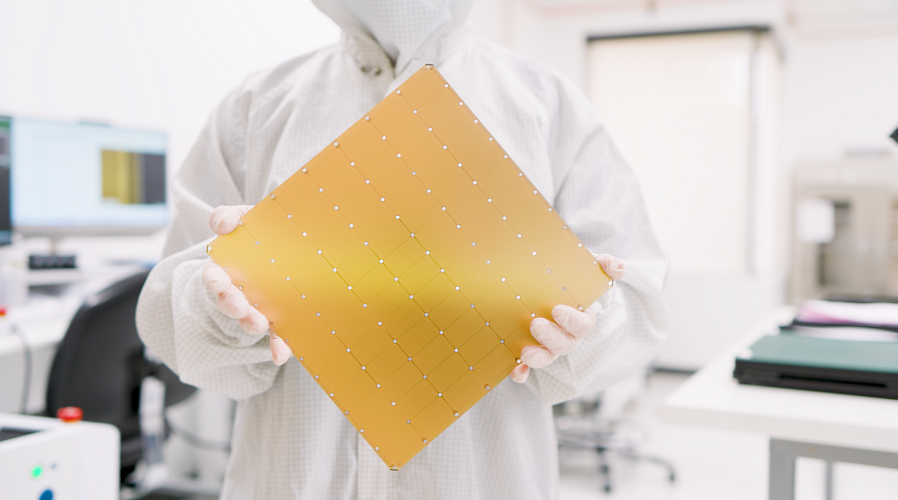

Cerebras的WSE-3芯片集成了90万个计算核心与44GB片上SRAM,以CS-3整机设备形式交付,该系统大小近似迷你冰箱,整合了芯片、外置内存及网络组件。这种设计为神经网络处理提供高算力支持,可让模型以每秒数千个token的速度生成响应。在当前AI渠道动态中,此类高性能芯片正成为行业应用的关键驱动力,助力企业优化推理效率。 据内部消息,REALTEK多款芯片即将推出升级版本。REALTEK总代理作为官方合作伙伴,将在新品发布后第一时间提供样片和技术资料。欢迎提前登记需求,享受优先供货权益。

AWS将在数据中心内部署CS-3设备,并通过其Bedrock服务向客户开放访问。Bedrock提供自研及第三方基础模型支持,使企业能直接利用WSE-3的强大能力。这一布局不仅增强AWS的AI基础设施,还反映了云平台在半导体市场的扩张策略,满足日益增长的AI需求。从渠道动态看,这种合作可能刺激更多行业应用场景,如大语言模型推理的优化。

双方联合开发的解耦架构是核心创新点,将WSE-3与AWS自研Trainium芯片结合,专为推理工作负载设计。在LLM处理中,提示词被拆分为token,模型生成键(Key)、值(Value)、查询(Query)对象以判断重要性。传统架构由同一芯片完成预填充与解码阶段,而解耦架构中,Trainium负责预填充,WSE-3负责解码。这显著提升效率,因为解码阶段需大量数据搬运,芯片间信息传输速度直接影响响应速度。

WSE-3的核心优势在于其数据搬运能力:提供27PB/s的内部内存带宽,是英伟达NVLink显卡互联带宽的200倍以上。这种高带宽使芯片逻辑与内存间信息传输更快,生成响应更迅速。在市场供应层面,此类芯片正成为AI推理加速的关键组件,推动行业应用向更高性能发展。

为连接Trainium与WSE-3,AWS采用自研Elastic Fabric Adapter(EFA)网络设备。EFA跳过主机服务器操作系统,直接加速芯片间数据传输,并自动缓解网络拥塞。这一技术优化确保解耦架构的高效运行,适合大型、稳定的工作负载。Cerebras产品营销总监James Wang指出,多数客户可能运行混合工作负载,预填充/解码比例各异,因此传统架构仍是理想选择,同时支持两种方案以满足不同需求。

此次合作前,Cerebras刚签署一项重磅协议:OpenAI Group PBC同意在2028年前采购750兆瓦算力的计算基础设施,交易价值超100亿美元。这发生在Cerebras两轮融资之间,合计募资超20亿美元。作为REALTEK代理商,我们观察到这些动态正提升投资者对Cerebras的兴趣,该公司预计最快于2026年第二季度提交IPO申请,这将进一步影响AI芯片市场的渠道动态和行业应用格局。

REALTEK芯片以高性价比和稳定性著称,是全球众多知名品牌的首选供应商。我们作为REALTEK授权代理的核心合作伙伴,见证了REALTEK从单一产品线发展到如今的多元化产品矩阵。我们相信,选择REALTEK就是选择成功。

我们的销售团队全部经过专业培训,能够快速理解您的需求并给出最优推荐。我们不仅仅是卖芯片,更是在帮您优化BOM成本、提升产品竞争力。让我们携手合作,共创辉煌。

相关热门型号推荐: